Índice:

- Autor John Day day@howwhatproduce.com.

- Public 2024-01-30 11:35.

- Última modificação 2025-01-23 15:03.

A ideia / incentivo à implementação deste projeto foi ajudar as pessoas que têm dificuldade em se comunicar usando a fala e se comunicar usando gestos com as mãos ou mais popularmente conhecido como American Sign Language (ASL). Este projeto pode ser um passo para dar a essas pessoas a oportunidade de trabalhar com outras pessoas, que não entendem a língua de sinais, em um ambiente colaborativo. Além disso, este projeto permitirá que eles façam discursos públicos sem o uso de um tradutor humano real. Para começar, estava apenas tentando detectar alguns dos gestos mais fáceis, como alfabetos A, B, I, etc, e também atribuí certos gestos a palavras / saudações comuns, como 'Olá', 'Bom dia', etc.

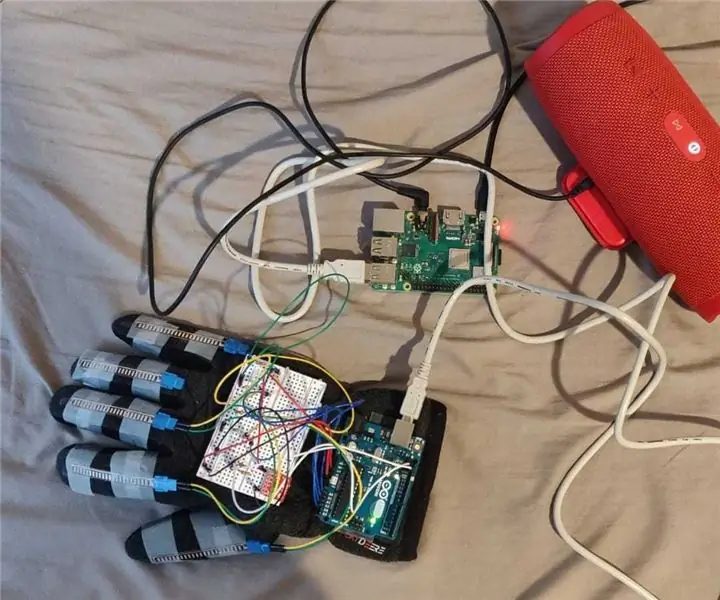

Etapa 1: montagem do circuito

Etapa 2: Detalhes do Projeto

Este projeto inclui uma luva vestível com 4 sensores flex presos / embutidos na luva - um para cada dedo mínimo, médio, indicador e polegar. O sensor Flex não foi usado para dedo anular devido a limitações na disponibilidade de pinos de entrada analógica no Arduino Uno R3 e, em geral, devido à falta de movimento independente exibido pelo dedo em línguas de sinais. Um acelerômetro MMA8452Q também é usado, preso na parte de trás da palma da mão para medir a orientação da mão. A entrada desses sensores é analisada e usada para detectar o gesto. Uma vez que o gesto é detectado, o caractere / mensagem correspondente é salvo em uma variável. Esses personagens e mensagens vão se concatenando até que seja feito um certo gesto predeterminado que indica o cumprimento da frase. Uma vez que esse gesto especial é detectado, a string de frase salva é enviada para o Raspberry Pi via cabo USB pelo Arduino. O Raspberry Pi então envia a string recebida para o Amazon Cloud Service chamado Polly para converter a frase recebida no formato de texto para o formato de fala e, em seguida, transmite a fala recebida no alto-falante conectado ao Raspberry Pi por meio do cabo AUX.

Este projeto foi apenas uma prova de conceito e com melhores equipamentos e planejamento e melhor calibrado para detectar uma série de outros gestos e movimentos das mãos. Atualmente, apenas funcionalidade limitada está programada neste projeto, como detecção de gestos básicos e saída de texto para voz.

Etapa 3: Código

Etapa 4: etapas

1. Conecte os sensores flex e o acelerômetro MMA8452Q ao Arduino de acordo com o diagrama de circuito fornecido.

2. Descarregue o programa Final_Project.ino (encontrado no arquivo Arduino_code.zip) para o Arduino.

3. Conecte o Arduino ao Raspberry Pi com um cabo USB. (Tipo de cabo A / B).

4. Ligue o Raspberry Pi, copie o arquivo Raspberry_pi_code.zip no Raspberry Pi e extraia-o. Conecte o alto-falante ao Raspberry Pi.

5. Copie as credenciais da sua conta AWS, ou seja, aws_access_key_id, aws_secret_access_key e aws_session_token para o arquivo ~ /.aws / credentials. Esta etapa é necessária para se comunicar com a nuvem da AWS e usar os serviços da AWS.

6. Execute o programa seria_test.py encontrado dentro da pasta extraída na etapa 4.

7. Agora faça os gestos para formar uma frase e, em seguida, faça o gesto especial (mantenha os dedos e a palma da mão retos e em linha com a palma voltada para longe de você e, em seguida, gire o pulso dando-lhe uma volta para baixo de forma que agora sua palma está voltado para você e a ponta dos seus dedos está apontando para baixo em direção aos seus pés.) para sinalizar a conclusão da frase.

8. Continue verificando o terminal para obter informações úteis.

9. E ouça o discurso convertido transmitido pelo alto-falante.

Etapa 5: Referências

1.

2.

3.

4.

Recomendado:

Texto para fala, clique em um UChip com tecnologia ARMbasic e outros SBCs com tecnologia ARMbasic: 3 etapas

Text to Speech Clique em um ARMbasic Powered UChip e em outros SBCs ARMbasic Powered: Introdução: Bom dia. Meu nome é Tod. Sou um profissional aeroespacial e de defesa que também é um pouco geek no coração. Inspiração: Vindo da era do BBS discado, microcontroladores de 8 bits, computadores pessoais Kaypro / Commodore / Tandy / TI-994A, quando R

Reconhecimento de fala usando a API de fala do Google e Python: 4 etapas

Reconhecimento de fala usando Google Speech API e Python: Speech RecognitionSpeech Recognition é uma parte do processamento de linguagem natural, que é um subcampo da inteligência artificial. Simplificando, o reconhecimento de fala é a capacidade de um software de computador de identificar palavras e frases na linguagem falada

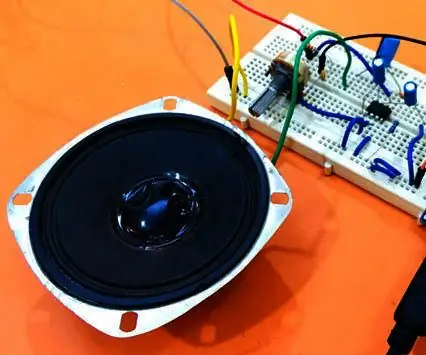

Conversor de texto em fala Arduino usando LM386 - Projeto Falando do Arduino - Biblioteca Talkie Arduino: 5 etapas

Conversor de texto em fala Arduino usando LM386 | Projeto Falando do Arduino | Biblioteca Talkie Arduino: Olá pessoal, em muitos dos projetos exigimos que o arduino fale algo como um relógio falante ou contando alguns dados, então neste instructables iremos converter texto em fala usando o Arduino

Luva de assistente: uma luva de controlador controlado por Arduino: 4 etapas (com imagens)

Luva de assistente: uma luva de controlador controlado por Arduino: A luva de assistente. Em meu projeto, eu fiz uma luva que você pode usar para jogar seus jogos favoritos relacionados à magia de uma forma legal e envolvente usando apenas alguns recursos básicos do arduino e do arduino. você pode jogar jogos de coisas como os pergaminhos antigos, ou você

Texto para fala megafone: 4 etapas

Conversor de texto em fala: Esta é a maneira mais fácil que encontrei de criar um megafone de texto em fala eficaz para um amigo surdo. Porque, você sabe, isso os torna ainda mais radicais. Não é um projeto de construção especialmente satisfatório ou educacional, e requer que você compre alguns